AIがお問い合わせ文を自動作成

面倒な文章入力は不要。ポチポチ選ぶだけで、

あなたのご相談内容をAIが整理します。

もちろん、直接お問い合わせ文を入力することもできます。

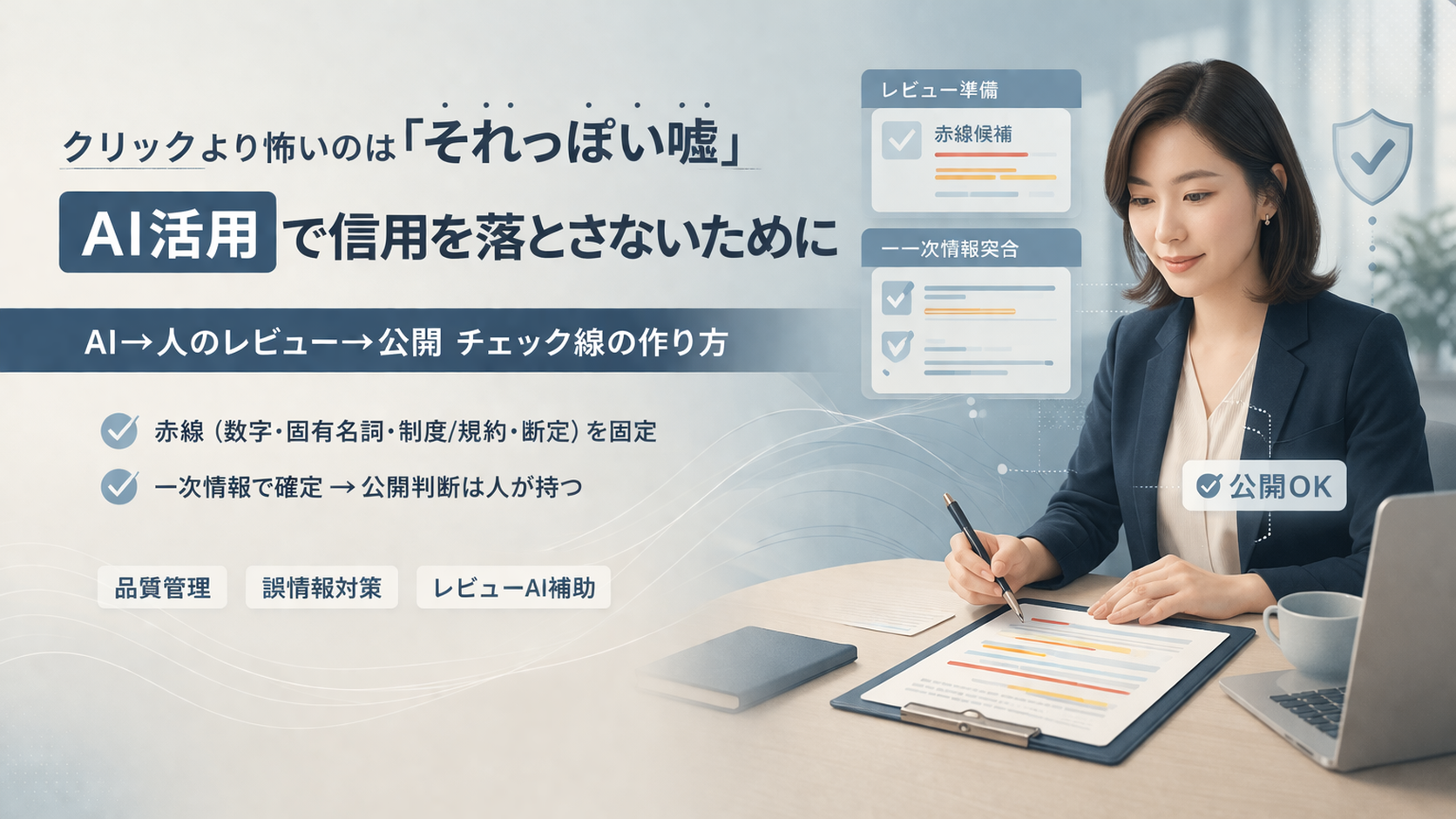

生成AIを業務に入れた直後に起きやすい失敗が、AIが自信満々に出す“それっぽい嘘”です。社内資料ならまだしも、Web記事や告知、FAQなど外部公開で誤情報を載せると、訂正コストだけでなく信用失墜につながります。品質管理の立場では「誤りが怖い」は当然の感覚で、怖いからこそ仕組み(チェック線)で抑える必要があります。

この記事では「失敗後」の立て直しとして、現場が回せるチェック線(レビュー)を作る方法を、テンプレ・役割分担・運用のコツまで含めて整理します。ポイントは、AIの文章を“完成品”として扱わず、検証できる主張の集合として扱うことです。

AI活用 AIのそれっぽい嘘を防ぐ近道は、AIの出力を検証できる単位に分解し、リスクの高い箇所にチェック線を引いて潰すことです。現場で実装するなら、次の4ステップが最短です。

重要なのは「全部チェックする」ではなく、リスクが高いところほど濃いチェックにすることです。チェックが重すぎると、現場は抜け道を探します。軽すぎると事故が再発します。両方を避ける設計がチェック線です。

失敗後に再発しやすいのは、原因が「AIが悪い」で片付けられ、運用ルールが整わないことです。品質管理として押さえておきたい“再発の型”を先に共有します。

特に怖いのは、1回の誤情報掲載よりも、訂正後の対応がバラバラで「また起きそう」と思われることです。チェック線は、外部から見えない裏側の話ですが、再発防止の強度がそのまま信頼に跳ね返ります。

AIの誤りは「嘘をつこう」として起きるのではなく、もっと地味な理由で混ざります。発生源を押さえると、チェック線を引く場所が明確になります。

社内ルール、製品仕様、最新の料金、対象地域など、正解が社内にしかないのに、AIには渡っていないケースです。AIは空白を“それっぽく”埋めます。ここで必要なのは「AIに考えさせる」ではなく、AIに参照させる設計です。

抽象度が高い指示は、無難な一般論が混ざり、断定表現だけが残りがちです。品質管理では、プロンプト改善より先に「赤線」を決める方が効きます。なぜなら、一般論が混ざっても事故になるのは多くの場合、赤線領域だからです。

法務・医療・金融・安全など、断定を避けるべき領域で、言い切りのトーンのまま出してしまう問題です。断定可否は“文章の良し悪し”ではなく、運用ルールで決める領域です。

制度・価格・仕様・担当窓口など、時間で変わる情報は、日付や版管理がないと誤りになりやすいです。チェック線に「日付・対象範囲・版」を含めるだけで事故率が下がります。

「詳しい人がたまたま見たから大丈夫」では再発します。チェック観点を固定し、誰でも線を引ける状態にします。属人性をゼロにする必要はありませんが、属人性に依存しない仕組みは必須です。

ここでいうチェック線は、工程図のように「ここを通ったら公開してよい」という線引きです。AI活用の現場ではAI→人のレビュー→公開が基本ですが、品質管理はさらに「何を誰が見るか」を決めます。

ポイントは、赤線だけは「一次情報に当てる」ことです。検索で出た二次情報だけで済ませない、がルールになります。一次情報がないなら「断定しない」へ倒す、もセットで決めます。

現場が忙しい場合は、まずこの最小構成で回し、事故が起きやすい領域だけ二名体制にするのが現実的です。

レビューAI(AIによるチェック)自体は有効ですが、万能ではありません。おすすめは、レビューAIにチェックの準備をさせ、人が最終判断をする形です。ここを曖昧にすると「AIがチェックしたから大丈夫」という誤解が生まれます。

この分業にすると、品質管理は「全部読む」から「赤線を潰す」に変わり、運用が回りやすくなります。

誤りが怖いときほど、チェックを増やしがちです。ただし工程が重くなると、現場は抜け道を探します。そこで、公開物をリスクで3段階に分け、チェック線の濃さを変えます。

この優先順位を明文化すると、「AIの AI(なんとなくAI任せ)」を防ぎ、チェックが文化になります。特に高リスクは、スピードより再発防止を優先する、と線を引いておくと揉めにくいです。

チェック線は「ルールを書いて終わり」では回りません。現場に落とすには、最低限この3点セットが必要です。

赤線は、案件ごとに増やしすぎると破綻します。まずは共通で事故りやすいものを固定し、業務に応じて追加します。

赤線は「何に当てて確定するか」が決まっていないと、チェックが漂流します。参照元の型を先に決めます。

チェック線の肝は責任の所在です。現場が回る落とし所としては「作成者」「一次情報突合者」「公開責任者」の3役を明確にします。

ここが曖昧だと、失敗後の現場は「誰もOKと言えない」か「誰かが勝手に出す」の両極端になります。

赤線(数字・固有名詞・制度/規約・断定・比較)だけは必須にし、他はリスクで濃淡を付けるのが現実的です。まず“事故る箇所”に線を引くのが再発防止になります。

不要にはなりません。レビューAIは抜けの発見や候補抽出は得意ですが、一次情報との突合と公開判断は人の責任で行う設計が安全です。

原因の特定より先に「チェック線」と「赤線項目」を決めるのがおすすめです。次の公開物から再発しない仕組みを先に作れます。合わせて、日付・版管理(いつの情報か)を最低限入れると事故率が下がります。

断定を避ける領域は、テンプレで表現を固定します。たとえば「一般的には」「場合があります」「公式情報をご確認ください」など、ルールとして入れておくとブレが減ります。赤線領域は“言い切らない”を基本にして、一次情報が揃った場合のみ断定する設計が安全です。

AI活用 AIのそれっぽい嘘を防ぐには、主張を分解し、リスクの高い箇所にチェック線(レビュー)を引くことが最短です。レビューAIは補助として使い、人が一次情報で確定し、公開判断をする。これだけで「誤りが怖い」状態から抜け出しやすくなります。

まずは現状整理だけでもOKです。いまの制作フローに合わせて、赤線項目とチェック線(レビュー)の設計から一緒に整えることもできます。